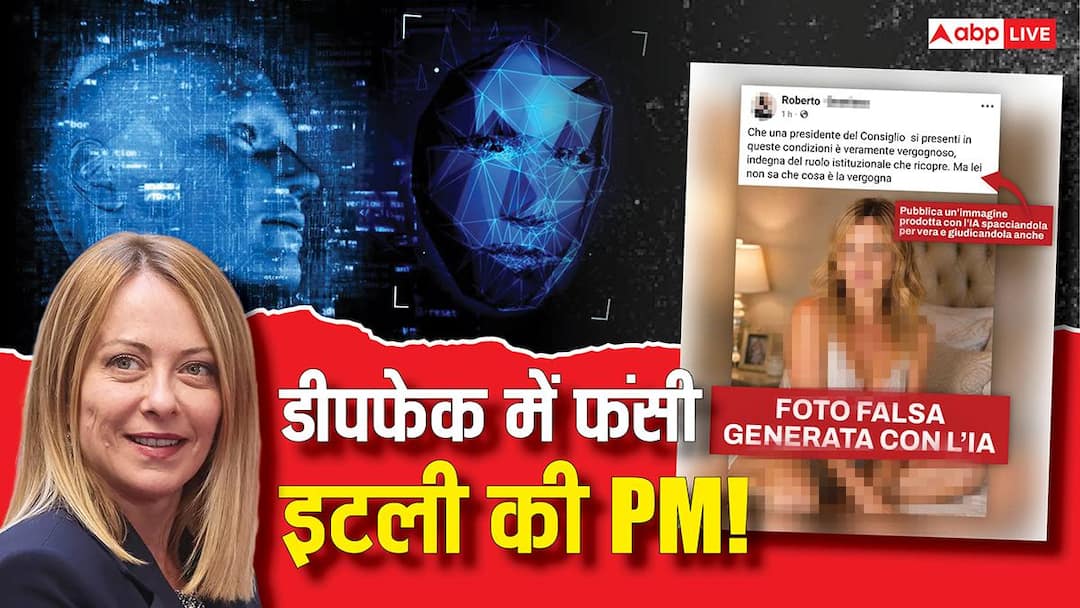

इटली की प्रधानमंत्री जॉर्जिया मेलोनी ने खुद X और फेसबुक पर अपनी तस्वीर शेयर करते हुए लिखा, ‘पिछले कुछ दिनों से मेरी कई नकली तस्वीरें घूम रही हैं, जिन्हें AI से बनाकर कुछ राजनीतिक विरोधी असली बता रहे हैं.’ उन्होंने आगे कहा, ‘जिसने भी ये तस्वीरें बनाई हैं, उसने मुझे और बेहतर दिखा दिया है,’ लेकिन साथ ही आगाह किया कि सच तो यह है कि लोग अब हमला करने और झूठ फैलाने के लिए कुछ भी कर सकते हैं.’ मेलोनी की अश्लील डीपफेक तस्वीर ने नई बहस छेड़ दी है कि जब प्रधानमंत्री पद पर बैठा व्यक्ति इससे नहीं बचा, तो आम लोगों की तस्वीरों का क्या इस्तेमाल होता होगा? आइए समझते हैं डीपफेक की दुनिया को…

Girano in questi giorni diverse mie foto false, generate con l’intelligenza artificiale e spacciate per vere da qualche solerte oppositore.

Devo riconoscere che chi le ha realizzate, almeno nel caso in allegato, mi ha anche migliorata parecchio. Ma resta il fatto che, pur di… pic.twitter.com/or44qru2qj

— Giorgia Meloni (@GiorgiaMeloni) May 5, 2026

डीपफेक क्या है और कैसे काम करता है?

‘डीपफेक’ शब्द दो अंग्रेजी शब्दों ‘डीप लर्निंग’ और ‘फेक’ से मिलकर बना है. यह आर्टिफिशियल इंटेलिजेंस (AI) पर आधारित एक ऐसी तकनीक है जो बेहद सच्ची लगने वाली नकली तस्वीरें, वीडियो या ऑडियो रिकॉर्डिंग बना सकती है. डीपफेक बनाने के दो बड़े तरीके हैं:

- जनरेटिव एडवर्सरियल नेटवर्क (GAN): यह दो न्यूरल नेटवर्क के बीच कॉम्पिटीशन जैसी प्रोसेस है. पहला ‘जनरेटर’ नकली तस्वीर बनाता है और दूसरा ‘डिस्क्रिमिनेटर’ उसे परखकर बताता है कि वह असली है या नहीं. जब जनरेटर हर बार डिस्क्रिमिनेटर को धोखा देने में कामयाब होता है, तो आखिर में वह इतनी सटीक नकली तस्वीर बनाने लगता है जिसे असली से अलग कर पाना मुश्किल होता है.

- डीप ऑटोएनकोडर: इसमें पहले AI को किसी व्यक्ति (जैसे मेलोनी) की सैकड़ों तस्वीरों पर ट्रेनिंग दी जाती है. फिर वह किसी दूसरे व्यक्ति के चेहरे के भावों को उस व्यक्ति के चेहरे पर इस तरह फिट कर देता है मानो वह खुद वह भाव बना रहा हो.

डीपफेक का कारोबार कितना बड़ा है?

इस तकनीक का बाजार बेहद तेजी से बढ़ रहा है. फॉर्च्यून बिजनेस इनसाइट्स की एक रिपोर्ट के मुताबिक, ग्लोबल डीपफेक टेक्नोलॉजी मार्केट 2025 में 9.19 अरब डॉलर का था और 2026 में बढ़कर 11.18 अरब डॉलर होने का अनुमान है. 2034 तक इसके 51.42 अरब डॉलर तक पहुंचने की संभावना है, जो 21% की सालाना दर से बढ़ रहा है. बाजार के इस विस्फोटक विकास के कुछ चिंताजनक पहलू भी हैं:

- पिछले तीन सालों में डीपफेक धोखाधड़ी के प्रयासों में 2,137% की बढ़ोतरी हुई है.

- 2025 में डीपफेक से जुड़ी 1,567 अनोखी घटनाएं दर्ज की गईं और करीब 1.3 अरब डॉलर की धोखाधड़ी की पुष्टि हुई.

- 90% ऑनलाइन सामग्री 2026 के अंत तक AI-जनित हो सकती है.

आपकी तस्वीरों से छेड़छाड़ कैसे संभव है?

डीपफेक बनाने के लिए AI को डेटा की जरूरत होती है. आप अपनी जो तस्वीरें और वीडियो फेसबुक, इंस्टाग्राम और X जैसे सोशल मीडिया प्लेटफॉर्म पर डालते हैं, वही इसका चारा बन सकता है. मेलोनी के मामले में, आरोपियों ने उनकी और कई अन्य इतालवी महिलाओं की सोशल मीडिया से तस्वीरें लेकर उनके साथ छेड़छाड़ की थी. इसलिए, सार्वजनिक रूप से उपलब्ध आपकी कोई भी फोटो या वीडियो AI के जरिए गलत इस्तेमाल होने का खतरा हमेशा बना रहता है, चाहे आप एक आम नागरिक हों या प्रधानमंत्री.

तो फिर डीपफेक के खतरे से खुद को कैसे बचाएं?

डीपफेक से बचने के लिए 5 स्टेप्स फॉलो करें:

- पहले जांचो, फिर भरोसा करो: मेलोनी ने खुद यह सलाह दी है. किसी भी संदिग्ध फोटो या वीडियो को तुरंत सच न मानें.

- टूल्स का इस्तेमाल करें: रियलिटी डिफेंडर, सेंसिटी AI और डीपवेयर स्कैनर जैसे डीपफेक डिटेक्शन टूल AI-जनित तस्वीरों की पहचान कर सकते हैं.

- गूगल का ‘अबाउट दिस इमेज’ टूल: गूगल का यह फीचर किसी भी तस्वीर का ओरिजिनल सोर्स और इतिहास बता सकता है.

- डिजिटल वॉटरमार्किंग: इटली और भारत जैसे देशों ने कानून बनाकर AI से बनी सामग्री पर वॉटरमार्क लगाना अनिवार्य कर दिया है ताकि आम लोग असली-नकली की पहचान कर सकें.

- पर्सनल इन्फॉर्मेशन सिक्योर करें: सोशल मीडिया पर अपनी प्राइवेट फोटोज अपलोड करने से बचें. अकाउंट को प्राइवेट रखें और अनजान लोगों की फ्रेंड रिक्वेस्ट एक्सेप्ट न करें.

क्या डीपफेक पर कानूनी सख्ती लगाई गई है?

इटली ने डीपफेक से नुकसान पहुंचाने वालों के लिए पांच साल तक की जेल की सजा का प्रावधान किया है. वहीं, भारत ने भी फरवरी 2026 में IT नियमों में संशोधन कर AI से बनी सामग्री पर लेबलिंग अनिवार्य कर दी है और गैरकानूनी कंटेंट को सिर्फ 3 घंटे में हटाने का नियम बनाया है.

मेलोनी का कहना है, ‘डीपफेक इसलिए खतरनाक है क्योंकि यह किसी को भी निशाना बना सकता है, धोखा दे सकता है और गुमराह कर सकता है.’ उन्होंने चेतावनी देते हुए कहा, ‘मैं अपना बचाव कर सकती हूं, लेकिन बहुत से लोग ऐसा नहीं कर सकते. आज यह मेरे साथ हो रहा है, कल किसी के साथ भी हो सकता है.’